)

Le double visage de l'intelligence artificielle en matière de protection des données et de confidentialité

À l'ère numérique, l'intelligence artificielle est une arme à double tranchant, présentant à la fois des risques importants et des solutions prometteuses en matière de protection des données et de confidentialité. Nous aidons nos clients à clarifier les interactions complexes de l'IA dans le domaine de la cybersécurité, en particulier pour les organisations et les personnes qui ne sont pas pleinement conscientes des techniques d'IA et qui tiennent compte des évolutions rapides du secteur.

UNE PRÉSENTATION

Que signifie l'IA pour la sécurité ?

Afin d'explorer l'impact significatif de l'IA sur la protection et la confidentialité des données, la première section de cet article a été entièrement conçue à l'aide d'outils d'IA. Ce qui suit est une transcription exacte du contenu généré par l'IA, basée sur une simple invite : « Analysons avec l'IA ce que l'IA signifie pour la sécurité ». La deuxième partie de l'article examinera les résultats en profondeur, en mettant fortement l'accent sur la manière dont les technologies d'IA remodèlent le paysage de la sécurité des données, de la protection de la vie privée et de la conformité réglementaire dans un monde de plus en plus numérique.

Le texte généré par l'IA

L'IA : une aubaine et un fléau

L'intelligence artificielle, de par sa conception même, cherche à imiter l'intelligence humaine par le biais d'algorithmes complexes et de traitements de données. Cette fonctionnalité permet à l'IA d'analyser de grandes quantités de données, d'identifier des modèles et de prendre des décisions avec une rapidité et une précision sans précédent. Cependant, cette force même de l'IA ouvre également de nouvelles voies pour les cybermenaces.

Les risques posés par l'IA

Le potentiel de l'IA pour transformer les industries est indéniable, mais elle introduit également de nouveaux risques en matière de protection des données et de confidentialité. Voici quelques-unes des principales préoccupations :

Violations de données : les systèmes d'IA ont besoin de grands ensembles de données pour fonctionner efficacement. Ces ensembles de données contiennent souvent des informations personnelles sensibles, ce qui en fait des cibles privilégiées pour les cybercriminels. Une faille dans de tels systèmes peut entraîner la divulgation de quantités massives de données personnelles.

Attaques automatisées : les pirates informatiques exploitent l'IA pour automatiser et étendre leurs attaques. Les malwares pilotés par l'IA peuvent s'adapter aux mesures de sécurité, ce qui complique leur détection et leur neutralisation. Par exemple, l'IA peut générer des e-mails de phishing hautement personnalisés, augmentant ainsi la probabilité que des personnes peu méfiantes soient victimes de telles escroqueries.

Deepfakes : la technologie de l'IA peut créer des images, du son et des vidéos réalistes mais faux. Ces deepfakes peuvent être utilisés à des fins malveillantes, telles que le chantage ou la diffusion de fausses informations, ce qui complique encore davantage le paysage de la protection des données.

L'IA entre les mains des hackers

À mesure que la technologie de l'IA évolue, les tactiques des cybercriminels évoluent également. Les pirates informatiques utilisent de plus en plus l'IA pour développer des méthodes d'attaque sophistiquées qui remettent en question les mesures de sécurité traditionnelles. Voici quelques exemples :

Hameçonnage basé sur l'IA : les attaques de phishing traditionnelles reposent souvent sur des messages génériques envoyés à de grands groupes de personnes. L'IA peut toutefois analyser les profils de réseaux sociaux, les e-mails et d'autres activités en ligne pour créer des e-mails de phishing hautement personnalisés, difficiles à distinguer des communications légitimes.

Malware adaptatif : l'IA permet aux malwares d'apprendre de leur environnement et d'adapter leur comportement. Cela signifie qu'une fois à l'intérieur d'un système, les malwares alimentés par l'IA peuvent modifier leurs tactiques pour éviter d'être détectés par les logiciels antivirus traditionnels.

Menaces persistantes avancées (APT) : les pirates peuvent utiliser l'IA pour mener des attaques ciblées à long terme appelées APT. L'IA permet à ces attaques de passer inaperçues tout en infiltrant les réseaux et en collectant des données sensibles sur de longues périodes.

Le pouvoir protecteur de l'IA

Malgré ces risques, l'IA propose également de puissants outils pour améliorer la cybersécurité et protéger les données. Utilisée de manière responsable, l'IA peut être un formidable allié dans la lutte contre les cybermenaces. Voici quelques façons dont l'IA peut vous aider :

L'IA au service de la détection et de la prévention des menaces

L'IA peut analyser de grandes quantités de données en temps réel, identifiant les anomalies et les menaces potentielles beaucoup plus rapidement que les analystes humains. Certaines applications clés incluent :

Analyse comportementale : l'IA peut surveiller les modèles de comportement des utilisateurs et détecter les écarts pouvant indiquer une faille de sécurité. Par exemple, si l'activité de connexion d'un employé change soudainement à des heures ou à des lieux inhabituels, l'IA peut signaler ce comportement pour une enquête plus approfondie.

Systèmes de détection d'intrusion (IDS) : les systèmes IDS alimentés par l'IA peuvent identifier les intrusions sur le réseau et y répondre en temps réel, minimisant ainsi les dommages causés par les cyberattaques.

Réponse automatisée : l'IA peut automatiser la réponse à certains types de cybermenaces. Par exemple, si un e-mail de phishing est détecté, l'IA peut automatiquement le mettre en quarantaine et alerter l'utilisateur, réduisant ainsi le risque qu'il soit ouvert.

L'IA dans la protection des données

L'IA peut également jouer un rôle crucial dans la protection des données personnelles :

Chiffrement des données : l'IA peut améliorer les techniques de cryptage des données, rendant ainsi plus difficile l'accès à des informations sensibles par des tiers non autorisés.

Contrôle d'accès : l'IA peut gérer l'accès aux données en évaluant en permanence le niveau de risque des utilisateurs et en ajustant les autorisations en conséquence. Cela garantit que seules les personnes autorisées ont accès aux informations sensibles.

Masquage des données : l'IA peut masquer des données sensibles dans des environnements hors production, ce qui permet aux entreprises d'utiliser des données réelles pour les tests et le développement sans compromettre la confidentialité.

Comment Reply peut vous aider

Chez Reply, nous comprenons la complexité de la double nature de l'IA en matière de cybersécurité. Notre équipe d'experts se consacre à tirer parti de l'IA pour fournir des solutions robustes de protection des données tout en atténuant les risques associés. Voici comment nous pouvons vous aider :

Évaluation complète des risques : nous procédons à des évaluations approfondies des risques afin d'identifier les vulnérabilités potentielles de vos systèmes d'IA et de recommander des mesures pour y remédier.

Solutions de sécurité basées sur l'IA : nous développons et mettons en œuvre des solutions de sécurité basées sur l'IA adaptées à vos besoins spécifiques, améliorant ainsi votre capacité à détecter, prévenir et répondre aux cybermenaces.

Surveillance et support continus : Nos services incluent une surveillance et un support continus pour garantir la sécurité de vos systèmes contre l'évolution des menaces.

Programmes de formation et de sensibilisation : nous proposons des programmes de formation pour informer votre personnel sur les dernières menaces liées à l'IA et sur la manière de les atténuer. La sensibilisation est un élément essentiel d'une stratégie de cybersécurité robuste, et notre formation garantit que votre équipe est bien préparée à faire face aux menaces potentielles.

Solutions d'IA personnalisées : Reconnaissant que chaque organisation a des besoins uniques, nous développons des solutions d'IA personnalisées pour répondre à vos défis de sécurité spécifiques. Qu'il s'agisse d'améliorer le chiffrement des données, de mettre en œuvre des systèmes avancés de détection des menaces ou de développer des protocoles de réponse automatisés, nos solutions personnalisées garantissent une protection complète.

Conclusions

En conclusion, si l'IA présente des défis importants en matière de protection et de confidentialité des données, elle offre également des outils puissants pour contrer ces menaces. En collaborant avec des experts tels que ceux de Reply, les organisations peuvent exploiter le pouvoir protecteur de l'IA tout en se prémunissant contre ses risques. Ensemble, nous pouvons naviguer dans ce paysage complexe et garantir un avenir numérique sécurisé.

La double nature de l'intelligence artificielle dans le domaine de la cybersécurité exige une approche équilibrée. Alors que nous continuons à innover et à développer des technologies d'IA, nous devons rester vigilants quant aux risques potentiels tout en saisissant les opportunités qu'ils présentent. En favorisant la collaboration entre les développeurs d'IA, les experts en cybersécurité et les organisations, nous pouvons créer un environnement numérique plus sûr pour tous.

Chez Reply, nous nous engageons à jouer un rôle de premier plan dans ce domaine, en fournissant des solutions de sécurité de pointe pilotées par l'IA qui permettent aux organisations de protéger efficacement leurs données et leur confidentialité. À mesure que nous progressons, nous nous concentrons toujours sur l'innovation, l'adaptabilité et l'excellence en matière de cybersécurité, afin de garder une longueur d'avance sur l'évolution des menaces et de continuer à fournir une protection inégalée à nos clients.

Les conclusions

Un aperçu de ce que l'IA a généré pour nous

Comme vous pouvez le constater, l'IA a parfaitement fonctionné, elle a créé un article parfait montrant exactement ce qui est utile pour comprendre les cyberrisques et les potentialités de l'IA et nous avons eu un très bon exemple de sa puissance.

Néanmoins, il y a aussi quelque chose d'un peu inquiétant à ce sujet. L'origine de ces informations n'est pas totalement claire, que ce soit à partir des données d'entraînement du modèle d'IA ou des données personnelles auxquelles il a accès. Et si l'outil d'IA utilisé est connecté à un site Web externe (ce n'était pas notre cas, mais c'est un cas d'utilisation courant), il aurait pu être « empoisonné » par des informations erronées ou dangereuses, il aurait pu être infecté par un logiciel malveillant, il aurait pu utiliser et donc exposer les données personnelles et sensibles de l'utilisateur auquel il a accès. En général, cela signifie que pour utiliser l'IA dans tous les aspects de notre vie, et en particulier lorsqu'il s'agit de toucher le monde physique, nous devons mettre en place un ensemble de contrôles qui pourraient certifier les résultats de l'IA, vérifier que tous les niveaux de sécurité sont respectés et que le résultat est conforme aux politiques, réglementations et valeurs éthiques de nos entreprises et de notre société.

Cette conviction fondamentale est au cœur de l'approche de Reply en matière d'IA, qui garantit que toutes les initiatives de l'organisation respectent les directives éthiques, en mettant l'accent sur le développement responsable de l'IA et la collaboration avec des parties prenantes externes.

Sécurité pour l'IA

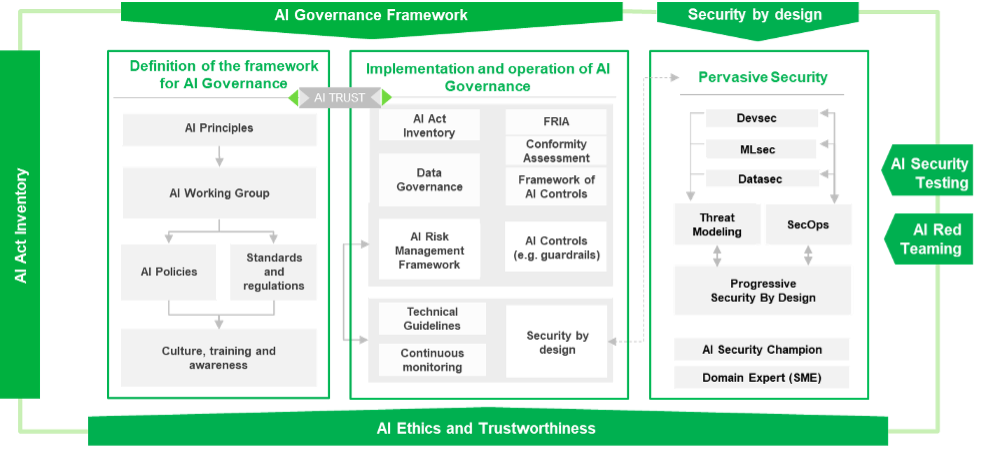

Sur la base de ces principes éthiques, les experts en sécurité de Reply ont développé un cadre complet de gouvernance et de conformité en matière de sécurité de l'IA pour gérer la configuration et le fonctionnement des systèmes d'IA, avec des contrôles de cybersécurité et des outils puissants pour protéger les données et les utilisateurs.

La mise en place du cadre d'IA est une étape fondamentale à planifier comme une action à court terme, compte tenu de deux facteurs principaux.

Le premier facteur est que les cas d'utilisation de l'IA actuellement présents sur le marché sortent de la sphère de l'innovation et deviendront très bientôt de véritables applications de production. En fait, ils utilisent également des données réelles pour ces cas d'utilisation initiaux, ce qui constitue déjà une préoccupation majeure pour les organisations CISO et CSO, et elles représenteront un risque croissant une fois qu'elles seront largement utilisées par les clients finaux et diffusées dans l'environnement numérique complexe présent dans chaque entreprise.

L'analyse et la sécurisation des cyberrisques liés aux outils et techniques d'IA constitueront donc un élément clé pour protéger les investissements, les organisations de cybersécurité jouant un rôle clé dans l'adoption de l'IA.

Le deuxième facteur est lié à la conformité à la loi sur l'IA, qui nécessite l'adoption d'une organisation et de processus dédiés pour analyser et classer chaque utilisation de l'IA dans l'entreprise. Les principales responsabilités incomberont aux entreprises utilisant des systèmes d'IA à haut risque, mais cela signifie que chaque entreprise doit suivre toute l'utilisation de l'IA, réaliser l'inventaire de l'IA, définir des principes et des politiques et classer les systèmes d'IA utilisés.

L'approche du projet proposée par Reply est sur mesure, visant notamment à concevoir et à mettre en œuvre un cadre spécifique et centré sur le contexte de l'entreprise, et spécifiquement intégré dans les taxonomies et méthodologies déjà définies et appliquées par les organisations de conformité et de cybersécurité.

L'IA au service de la sécurité

Outre les activités nécessaires à la protection des outils et des données d'IA, la cybersécurité pourrait absolument bénéficier de la puissance de l'IA. Pour exploiter pleinement cette opportunité, il est fondamental de bien savoir comment utiliser les puissants outils d'IA pour obtenir des résultats, tout en réduisant les risques et en appliquant tous les contrôles pertinents.

C'est pourquoi Reply utilise l'IA pour développer des agents de sécurité, formés dans deux domaines présentant des besoins majeurs en matière de tâches et de processus liés à la sécurité : le Secure SDLC, avec des agents d'IA aidant l'équipe de développement à introduire les exigences de sécurité et les tests selon une approche shift vers la gauche, et la réglementation DORA qui soutient les agents.

La réglementation DORA est un bon exemple de la manière dont l'IA peut être utilisée pour soutenir les organisations de sécurité et de conformité, grâce à une sélection rigoureuse d'agents spécialisés et correctement formés qui peuvent aider à rationaliser les processus d'analyse des documents et des contrats nécessaires à la conformité et qui nécessitent plusieurs personnes qualifiées pour être exécutés.

Reply adopte toujours un juste équilibre entre l'innovation, les besoins réels en matière de processus et les contraintes réglementaires lors de la sélection des fonctionnalités à implémenter avec ces agents. Notre objectif est de faire en sorte que les solutions que nous développons non seulement repoussent les limites des capacités technologiques, mais répondent également aux exigences commerciales pratiques et soient conformes aux normes et réglementations en vigueur. Cette approche nous permet de créer des outils pilotés par l'IA qui sont à la fois avant-gardistes et pragmatiques, offrant une réelle valeur tout en maintenant un haut niveau de confiance et de sécurité.

Spike Reply se spécialise dans le conseil en sécurité, l'intégration de systèmes et les opérations de sécurité et soutient ses clients depuis le développement de programmes de gestion des risques alignés sur les objectifs stratégiques de l'entreprise, jusqu'à la planification, la conception et la mise en œuvre de toutes les mesures technologiques et organisationnelles correspondantes. Grâce à un vaste réseau de partenariats, elle sélectionne les solutions de sécurité les plus appropriées et permet aux organisations d'améliorer leur posture de sécurité.

;Resize,width=660)

,allowExpansion;Resize,width=660)

,allowExpansion;Resize,width=660)

;Resize,width=660)

,allowExpansion;Resize,width=660)